Gredient Descent

NON Linear 논 리니어

리니어 : 선

분류가능한 그래프

Deep Learing

데이터를 전달하는 방식을 신경세포에서 유래됨

뉴런에서 비롯되었다.

전달시킬 때, 전달->전달로 처리됨

분류하고싶으면 로지스틱, KNN, SVM, D.T

(다들 알고리즘으로 동작한다.)

**** 외워야함

리그레션 : 예를들어 집 가격을 예측한다.

딥러닝,즉 뉴런은

뉴런 여러개 = 딥러닝

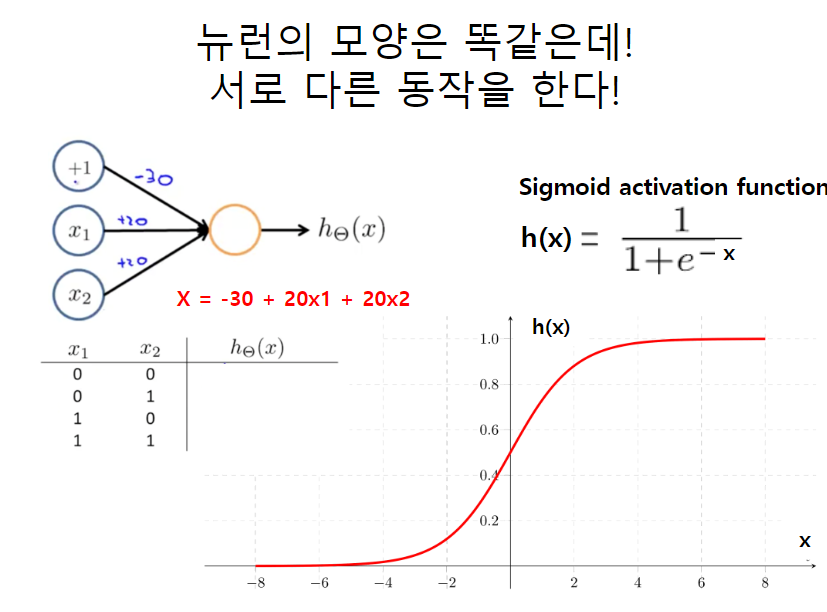

뉴런 : 가운데 딱잘라서 식이 두개다

왼쪽식은 입력x 화살표or선(숫자)

***인공뉴런

데이터는 숫자, 선(화살표)도 숫자이다.

입력받은 숫자들이 왼쪽에, 오른쪽엔 엑티베이션함수, 출력값이 나온다.

선은 랜덤 숫자이다.

y값은 0과1사이로 나온다.

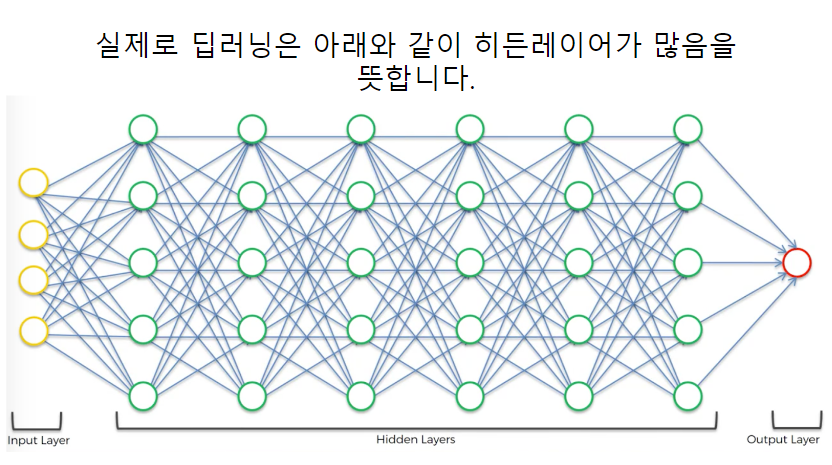

이런 동그란 뉴런이 여러개 있는 것이 딥러닝이다.

아래형태의 함수는 시그모이드 함수이다.

오른쪽은 1로 출력된다.

뉴런의 오른쪽에 쓸 수 있는 함수들

액티베이션 함수는 내가 선택한 값이다.

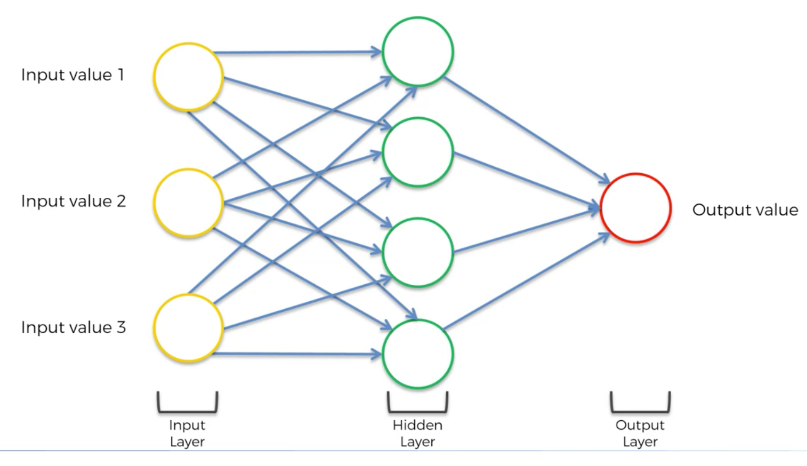

ANN(Artificial neural netwoks) Layers

계층 세로를 레이어라고 한다.

계층이 여러개인것을 딥러닝이라고 한다.

필수암기

인풋레이어, 히든레이어, 아웃풋 레이어

가장왼쪽은 인풋레이어, 가운데 노란부분은 히든레이어, 결과값이 아웃풋 레이어라한다.

핵심 : 선에 들어가는숫자가 몇이냐에 따라서 출력값이 무한으로 나온다.

*선을 가중치 or weight 라고 한다.

파라미터라고도 한다.

첫번째 레이어에서 계산이 끝났을 경우에만 다음 뉴런을 계산 할 수 있다. (아래참조)

Propagation 이라고한다. 프로파게이션.

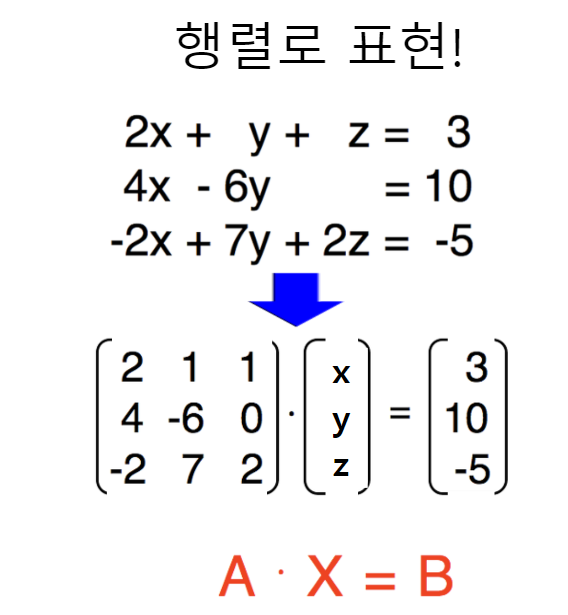

행렬계산은 GPU이다.

딥러닝은 데이터가 많아야 학습이 잘된다.

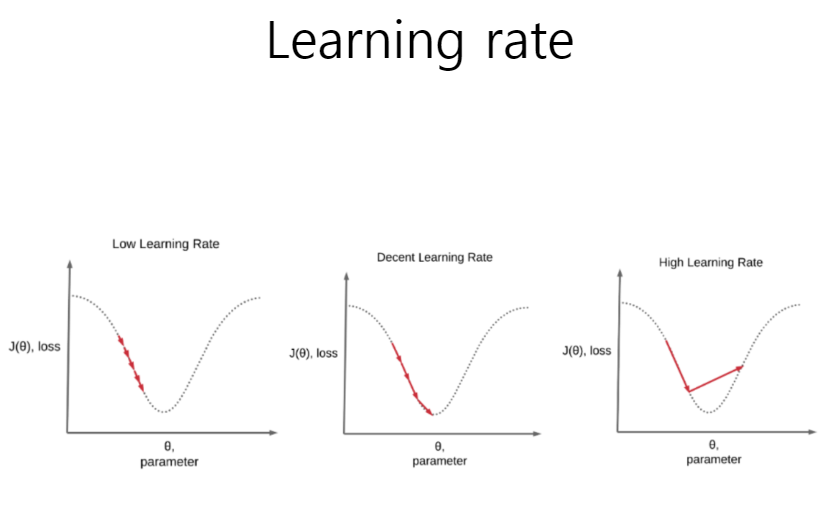

그래프의 기울기가 왼쪽으로 기울면 마이너스, 오른쪽이 세워지면 플러스이다.

Local minima(minimum) -> 부분적으로 최소의 지점

컴퓨터는 미분시킨다.

위의 표에서 참고할 문제는 알파(a) 이다.

** Epoch (에포크) - 데이터셋을 여러번 반복해서 학습한다.

** Batch(배치) - 한번 학습할 때 , 데이터를 하나씩이 아니라 10개씩 넣어서 학습한다.

** 시그모이나 탄젠트는 아웃풋때 사용, 히든에선 사용하지않는다.

앞으로가면 Propagation

뒤로가면 Back - ward protagation

'Deep Learning' 카테고리의 다른 글

| Deep Learning : EarlyStopping 라이브러리 사용법 (0) | 2022.06.13 |

|---|---|

| Deep Learning : validation data란 무엇이고, code에서 사용하는 방법 / 파라미터 validation_split (0) | 2022.06.13 |

| Deep Learning : learning rate를 옵티마이저에서 셋팅하는 코드 / 실습문제 풀기 (0) | 2022.06.13 |

| Deep Learning : 텐서플로우로, 분류의 문제 모델링 하는 방법 (0) | 2022.06.10 |

| Deep Learning : 텐서플로우에서 학습시 epoch와 batch_size에 대한설명 (0) | 2022.06.10 |